Continuiamo l’esplorazione dei contributi sull’AI che ci aiutino a inquadrare la faccenda tenendo conto delle implicazioni e delle relazioni di potere

Ancora a proposito di intelligenza artificiale (IA, Artificial intelligence). Tema con il quale dobbiamo fare i conti, senza paure ma nemmeno senza esaltare acriticamente possibilità e implicazioni che ancora sono tutte da comprendere.

Segnalo in primo luogo un articolo di Pino Donghi pubblicato su Doppiozero il 3 febbraio – ChatGPT. Donghi ci aiuta a capire un passaggio fondamentale nello sviluppo dell’IA che forse viene un po’ trascurato quando se ne scrive o se ne parla anche se è ormai parte della storia, visto che è un passaggio ormai vecchio di tre decenni. Un passaggio, che semplificando un po’, potremmo definire dalla teoria alla statistica.

Come fa a funzionare così bene l’intelligenza artificiale?

Quasi tutti ci eravamo accorti che da un po’ le traduzioni di Google non facevano più ridere. Tutt’altro che ottime, ovvio, ma molto utili.

Per esempio, Marjorie Pollock, vice-direttrice di un servizio di segnalazione epidemiologica, la notte di capodanno 2020 capisce rapidamente il senso e le implicazioni di un articolo di un sito cinese considerato affidabile. Da questo articolo, tradotto al volo da un sistema automatico, Pollock apprende, “per la prima volta, che un nuovo agente patogeno della famiglia dei Coronavirus sta per travolgere le nostre esistenze. Just simple as that: funziona!”.

Come fa dunque l’IA? La risposta, scrive Donghi, “a far data più o meno dagli inizi degli anni ’90 del secolo scorso, è: senza teoria!”. Continua Donghi: “Nel caso di Google translate senza una teoria scientifica del linguaggio, senza simboli e senza logica; senza una teoria anatomica del volto, se ti chiami Clearview e vendi servizi di face recognition alle forze di polizia, utilizzando invece 3 miliardi di immagini disponibili sui social media (e poi, via di forza bruta, via di potenza di calcolo).” In sostanza, l’attuale IA è il lavoro di circa trent’anni da questa svolta che ha portato a fare a meno della teoria, puntando sulla statistica.

LEGGI ANCHE:

– Il contributo di ChatGPT alla diffusione di informazioni false

– Il futuro dei libri: intervista a ChatGpt

Ma perché l’uso della teoria

non ha funzionato?

Donghi ci consiglia una breve ma efficace spiegazione di Nello Cristianini che insegna IA a Bristol e che in un video registrato per una delle letture del Mulino nel novembre 2021 – “Le macchine intelligenti. Capirle per poterci convivere” – ci aiuta a capire perché il progetto dell’intelligenza artificiale avviato negli anni ‘50 e proseguito fino alla fine degli anni ‘80 è fallito ed è stato sostituito dall’attuale: – spiega Donghi che “fino a quando si è pensato di sviluppare i programmi dell’intelligenza artificiale immaginando prima di mandare a memoria la teoria, acquisendo conoscenza e assiomi, poi di sviluppare l’algoritmo (prima la teoria linguistica, dicevamo, poi l’implementazione) ebbene, la macchina non ha mai funzionato”.

Qui il video con la lezione di Cristianini:

Senza teoria ma con la statistica,

in sostanza

“Basta teoria, al diavolo gli assiomi e la conoscenza: se non capisci un sistema non importa, basta emularne il comportamento, conta la previsione e non la comprensione del fenomeno che riproduciamo con la macchina. È l’alba del machine learning, quello che noi traduciamo con ‘apprendimento automatico’, è la storia dell’Intelligenza Artificiale degli ultimi 25-30 anni”, così Donghi.

E ancora: “Quel che fa l’intelligenza artificiale lo fa perché è intelligente come me? No! È perché pensa? Manco per sogno. È statistica e calcolo delle probabilità. L’intelligenza Artificiale non pensa come noi. La verità è che non pensa – anche se ci piace scriverlo – tantomeno capisce. Macina una quantità stellare di dati dove legge la previsione più probabile: oggi comincia a sfornare testi in tutto e per tutto simili a quelli che cucina la nostra naturale intelligenza, ma non lo fa come l’ultima versione di homo sapiens. Sicché funziona, in un’altra maniera ma funziona. Just simply as that!”.

Detto questo (e molto di più, leggete l’articolo di Donghi!) possiamo concludere dicendo, che la macchina registra quel che le viene affidato.

Ancora Donghi: “Nell’immettere dati dovremmo essere d’accordo su quali siano i valori umani da difendere: lo siamo? Se – si chiede Cristianini – voglio istruire un programmatore così che le stringhe garantiscano che la macchina sia neutrale, come faccio a definire la neutralità? Cosa significa? Vogliamo che i nostri cv – per essere ammessi all’Università, per essere assunti da un’azienda – siano vagliati da un programma? Vogliamo delegare a una macchina il giudizio in Tribunale? Si tratta di deleghe, ma sono scelte, umane. Non sono domande per le macchine. Non sono risposte per la tecnica. Bisogna dettare le regole, bisogna accordarsi sulla governance, è un problema di democrazia a livello planetario di cui, per altro, si sta già discutendo nelle sedi istituzionali: più che denunciare scandalizzati a mezzo stampa – per 24ore, al massimo 48 – più che chiamare ad una generica ribellione sulla rete social, bisogna prosaicamente impegnarsi, studiare e provare a dire la nostra”.

Chiudo questa puntata della nostra esplorazione nell’IA citando un libro proprio di Nello Cristianini che uscirà nei prossimi giorni dal Mulino e che affronta proprio quanto abbiamo visto in questo articolo, con le possibili implicazioni: La scorciatoia. Come le macchine sono diventate intelligenti senza pensare in modo umano.

Spiega la quarta di copertina del volume:

“Vagliano curricula, concedono mutui, scelgono le notizie che leggiamo: le macchine intelligenti sono entrate nelle nostre vite, ma non sono come ce le aspettavamo. Fanno molte delle cose che volevamo, e anche qualcuna in più, ma non possiamo capirle o ragionare con loro, perché il loro comportamento è in realtà guidato da relazioni statistiche ricavate da quantità sovrumane di dati. Eppure possono essere in certi casi più potenti di noi: ci osservano continuamente, e prendono decisioni al nostro posto. E allora come incorporarle nella nostra società senza rischi ed effetti collaterali? Questo libro – rigoroso, pungente, originale nell’approccio – ci spiega come siamo arrivati sin qui, e indica il percorso che ci aspetta prima di poterci fidare di questi nuovi agenti «alieni». La tecnologia non basta, occorre un dialogo tra scienze naturali e umane: è il passaggio cruciale per una convivenza sicura con questa nuova forma di intelligenza.”

La domanda cruciale che ci portiamo è dunque se non saranno proprio le asimmetrie di potere a decidere come rifornire di dati le intelligenze artificiali e in quali ambiti tali decisioni avranno conseguenze di discriminazione, di dominio e sottomissione.

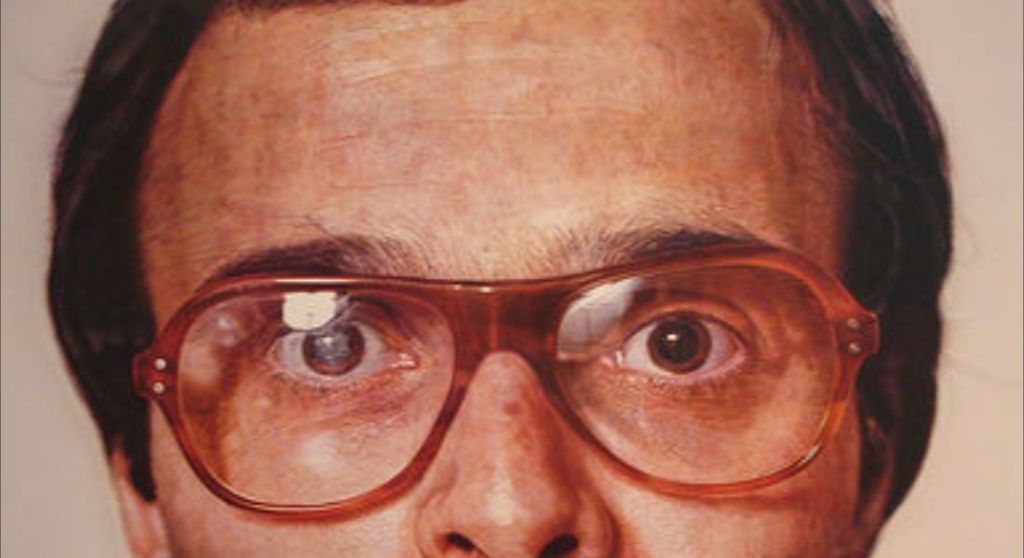

(Illustrazione, Chuck Close, Mark, 1979, WikiArt)

Lascia un commento